Propaganda 2.0

EU-Wahl: Wie Roboter im Netz die Meinung machen

Die Frisur sitzt, aber der Schal bereitet Probleme. Reza Kazemi zupft sich hektisch am roten Kaschmir, den er zu Hemd und offenem Sakko trägt. Gleich soll sein Vortrag über politische Kampagnen im Internet beginnen. Die Zuhörer in einem kleinen Konferenzraum des Brüsseler Europaparlaments warten bereits.

Kazemi nennt sich „Spin-Doctor“ - ein Politikberater, der Aufträge von Parteien annimmt. Sein Job: Menschen zum richtigen Kreuzchen zu bewegen. Und das, sagt er, gehe heute weniger über Werbespots, Plakate und Prospekte als durch Relevanz in sozialen Medien. Computergesteuerte Debatten können Wahlkämpfe ins Trudeln bringen; die Abwehr digitaler Angriffe bereitet überall Kopfzerbrechen. Denn ja, meint der Politik-Experte, im Internet herrsche ein Kampf um die Meinungsmacht, oft mit unsauberen Mitteln.

Die Abgeordneten des EU-Parlaments, die heute Abend gekommen sind, lauschen Kazemis Vortrag gespannt. Sie tagen zu einem Phänomen, das kurz vor der Europawahl Ende Mai viele Politiker Brüssel verunsichert. Bots und künstliche Intelligenz - von den Begriffen haben sie alle schon gehört. Aber welche Bedeutung könnten sie für den Wahlkampf zwischen Lissabon und Helsinki haben?

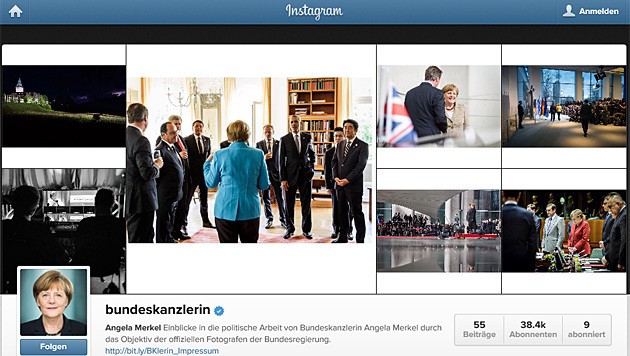

„I love Putin“ auf Merkels Instagram-Seite

Kazemi erinnert an einen Tag im Sommer 2015, als die deutsche Bundeskanzlerin Angela Merkel ihren Account im sozialen Netzwerk Instagram eröffnete. Es dauerte nur wenige Stunden, bis sich russische Internet-Trolle auf ihrer Seite austobten. Fake-Nutzer schrieben unzählige Kommentare wie „I love Putin“ und „Putin is the best“. Außerdem beleidigten sie Merkel. Die Bundesregierung musste das Konto vorübergehend offline nehmen. Mittlerweile sind die Hetzkampagnen in den Kommentarspalten deutlich ausgefeilter - und sie können jeden treffen.

„Ein Troll ist ein Mensch hinter einer Software“, erklärt Kazemi. Oft stammten die Angriffe aus sogenannten Troll-Fabriken in Russland. Rund um die Uhr arbeiteten hier Tausende Menschen und steuerten unzählige Social-Media-Profile von Menschen, die gar nicht existierten. Die sogenannten Social Bots agierten dann automatisiert. „12 Menschen können so den Eindruck erwecken, als hätten 25.000 Menschen etwas geteilt“, sagt Kazemi. Das wiederum führe zu großer Aufmerksamkeit - letztlich auch in den etablierten Medien.

Relevanz lässt sich künstlich erzeugen

Auch Paul Lukowicz ist an diesem Abend ins Europaparlament gekommen. Der 51-Jährige ist Leiter des Forschungsbereiches Eingebettete Intelligenz am Deutschen Forschungszentrum für Künstliche Intelligenz. „Als ich ein junger Mann war, musste man, um nationale Aufmerksamkeit zu bekommen, zu einer Zeitung gehen. Da war ein Filter, der darüber bestimmt hat, wer Aufmerksamkeit bekommt“, erinnert er sich. Heute sei das anders. Im Internet lasse sich mit der richtigen Technik Relevanz für etwas generieren, das bisher zurecht als völlig irrelevant gelte.

Allerdings, so Lukowicz, dürften Bots keineswegs nur verteufelt werden. „Interessant ist doch, dass wir in unserer Meinungsbildung entscheidend auf Bots angewiesen sind - nehmen Sie das Beispiel Google.“ Auch Suchmaschinen seien Bots, die sich durch das Netz wühlten und auf Basis von Algorithmen nach Relevantem suchten. In Zukunft, meint Lukowicz, würden wir noch viel stärker mit Bots kommunizieren. „Es geht also nicht darum, das Phänomen zu verweigern, sondern es so auszugestalten, dass es keinen Schaden verursacht.“

Diskussion über Gestaltung

Genau über eine solche Gestaltung wird in Brüssel seit Monaten diskutiert. Denn die Sorge vor manipulativen Kampagnen ist vor der Europawahl besonders groß. Unter dem Schlagwort Desinformation machen sich die EU-Institutionen darüber Gedanken, wie gegen die gezielte Verbreitung falscher oder irreführender Informationen vorgegangen werden könnte.

Bereits im Dezember stellte die EU-Kommission einen Aktionsplan gegen Propaganda im Internet vor. Das Budget einer 2015 eingerichteten Task Force gegen russische Einflussnahme wurde verdoppelt und ein Schnellwarnsystem, über das EU-Staaten Manipulationsversuche melden können, auf den Weg gebracht. Außerdem verpflichteten sich Plattformen wie Facebook, Twitter und Youtube, Social Bots zu kennzeichnen oder zu löschen. Wie viel dies nützen wird, ist unklar. Manche EU-Staaten, insbesondere aus Osteuropa, wünschen sich bereits eine deutlichere Antwort auf Hetzkampagnen und Fake News.

Berater Kazemi jedenfalls zeigt sich unbeeindruckt. Solange der Meinungskampf in den Foren ungezügelt weitergeht, entwickelt er für seine politischen Mandanten eigene Lösungen. „Wir bauen Bots, die andere Bots zerstören“, erklärt er und klingt ein bisschen stolz. Seine Firma setze Fake-Profile ein, die darauf programmiert seien, Facebook andere Bots zu melden. Dann erkenne das Netzwerk fremde Bots wie auch eigene - und lösche am Ende alle.

krone.tv

Mehr Digital

Kommentare

Da dieser Artikel älter als 18 Monate ist, ist zum jetzigen Zeitpunkt kein Kommentieren mehr möglich.

Wir laden Sie ein, bei einer aktuelleren themenrelevanten Story mitzudiskutieren: Themenübersicht.

Bei Fragen können Sie sich gern an das Community-Team per Mail an forum@krone.at wenden.